GPT-3 到底是什么?

那么,GPT-3 到底是什么呢?

我现在可以玩吗?

它是如何工作的?

我是一名前端开发人员,它会抢走我的工作吗?

如果您上周在互联网上不太活跃,那么您可能已经到处看到了“GPT-3”这个术语。

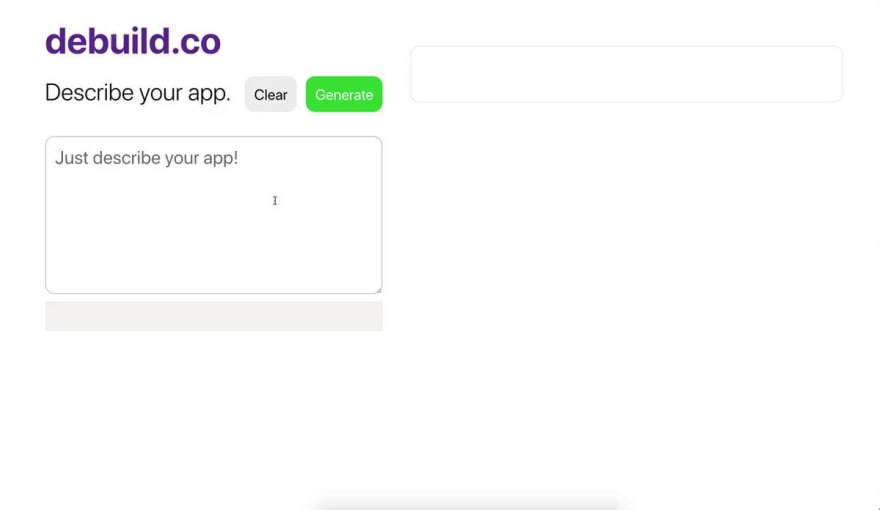

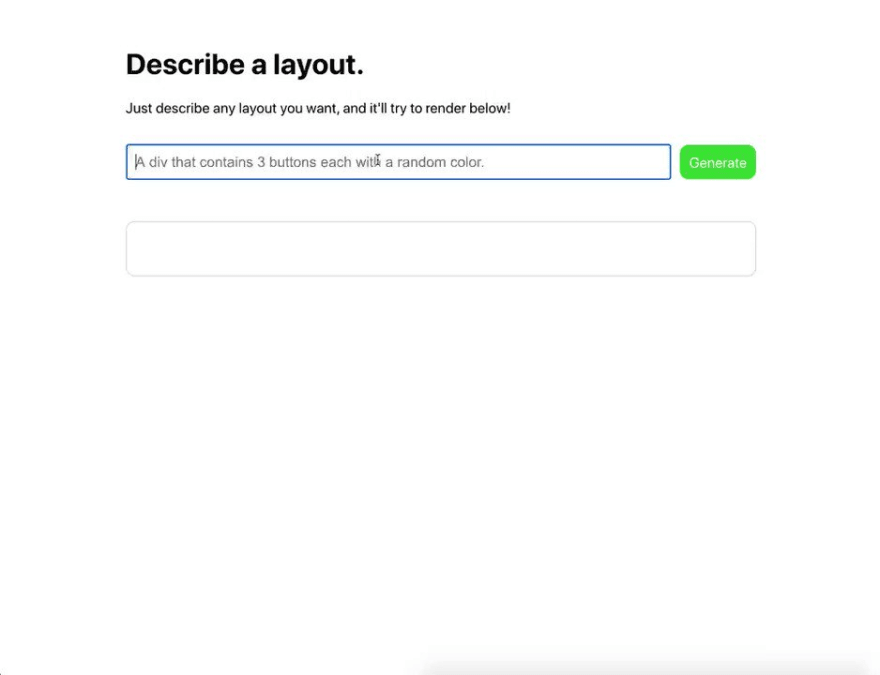

无论是在 JSX 代码生成器、论文生成器还是在文本到 UI Figma 插件中,GPT-3 提供的结果似乎都令人印象深刻,甚至有点令人害怕。

但是大多数推广它的推文并没有过多地讨论它是什么或者它是如何工作的,所以我写这篇文章是为了满足我的好奇心,也希望能够满足你的好奇心。

请注意,我对这个主题完全不了解,所以我甚至不想在这里得出任何结论,我只是将一些有关它的信息拼凑在一起,这样你就不必这样做了。

那么,GPT-3 到底是什么呢?

GPT 代表生成式预训练 Transformer,其中“3”代表第三代。你可以把它想象成一个工具,给定一个初始文本样本,尝试预测接下来的内容。

GPT-3 是由 OpenAI 创建的,OpenAI 是“一家位于加利福尼亚州旧金山的人工智能研究和部署公司”,其使命是“确保通用人工智能造福全人类”,根据其关于页面所述。

此外,OpenAI 背后还有 Sam Altman 和 Elon Musk 这样的人才,以及 Ilya Sutskever 和 John Schulman 等杰出研究人员的支持。所以,他们的实力确实不俗。

我现在可以玩吗?

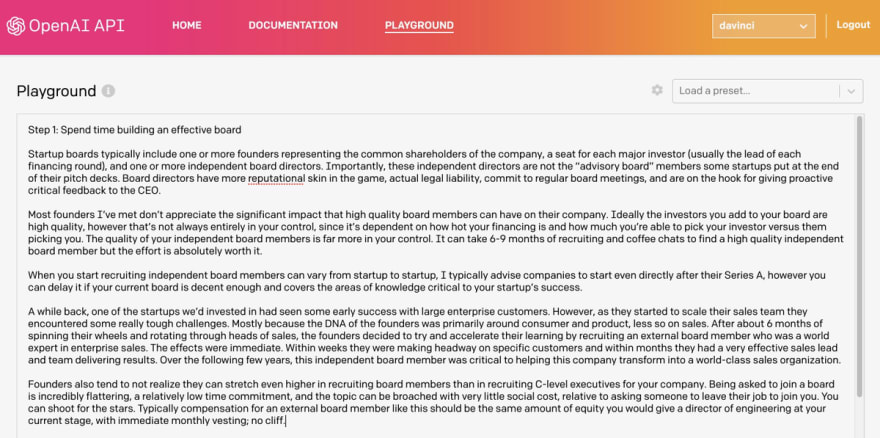

这种情况极不可能发生,OpenAI 的 API(我推测 GPT-3 就是在其上运行的)目前处于免费的私人测试阶段,他们正在制定定价策略。

他们的注册表中还提到了学术访问权限,您可以试试运气,但似乎您需要提供一个可靠的用例或理由来解释为什么您需要它。

它是如何工作的?

我没有资格回答这个问题,抱歉。

但是,我发现了一篇关于 GPT-2 的非常深入的文章,我猜测它可能会分享架构和核心概念。

一篇题为《OpenAI 的 GPT-3 语言模型:技术概述》的文章,其中作者探讨了该模型的硬件/训练方面。

最后,Founders Fund 的负责人 Delian Asparouhov 也分享了他对 GPT-3 的一些想法,他表示:

解释其工作原理最简单的方法是,它会分析互联网上的大量文本样本,并学习根据先前的上下文预测句子中接下来会出现哪些单词。根据你提供的上下文,它会根据所有这些文本数据进行学习,并根据它认为统计上最有可能的答案来回复你。

而且,他似乎有点失去理智了。

哦,如果你想深入了解(我没有),你可以继续查看 GPT-3 论文本身:语言模型是小样本学习者。

我是一名前端开发人员,它会抢走我的工作吗?

现在还不行,我不这么认为。

这无疑带来了一些关于自动化的有趣问题,以及用英语“编码”可能有助于消除哪些障碍。它或许能让初学者更容易编码,或许能完全取代枯燥的编码部分,让我们有更多时间和精力去做真正有意义的事情,谁知道呢?

我知道这些推文乍一看可能有点吓人,但我很高兴看到这种技术如何成为新开发工具的动力。

那么,你对此有何看法?我很想听听人工智能/机器学习领域的专业人士对此的看法。

嘿,我们联系吧👋

在 Twitter 上关注我并告诉我您喜欢这篇文章!

如果你真的喜欢它,请务必与你的朋友分享,这会对我有很大帮助😄

鏂囩珷鏉ユ簮锛�https://dev.to/vtrpldn/what-the-heck-is-gpt-3-anyway-45pc 后端开发教程 - Java、Spring Boot 实战 - msg200.com

后端开发教程 - Java、Spring Boot 实战 - msg200.com