window.ai - 从 DevTools 本地运行 AI!🤯

浏览器中的设备内置 AI 已经出现 - 有点。

它目前位于 Chrome canary 中,这意味着它很快就会出现。

在本文中,我将向您展示如何在您的设备上运行它,以便您可以使用它并了解您能想到的用例。

我只想说:在没有互联网连接的情况下window.ai从 DevTools运行非常有趣,即使结果很“糟糕”!

设置

启动并运行仅需 5 分钟!

1. 下载 Chrome Canary

前往Chrome Canary 网站并下载 Chrome Canary。

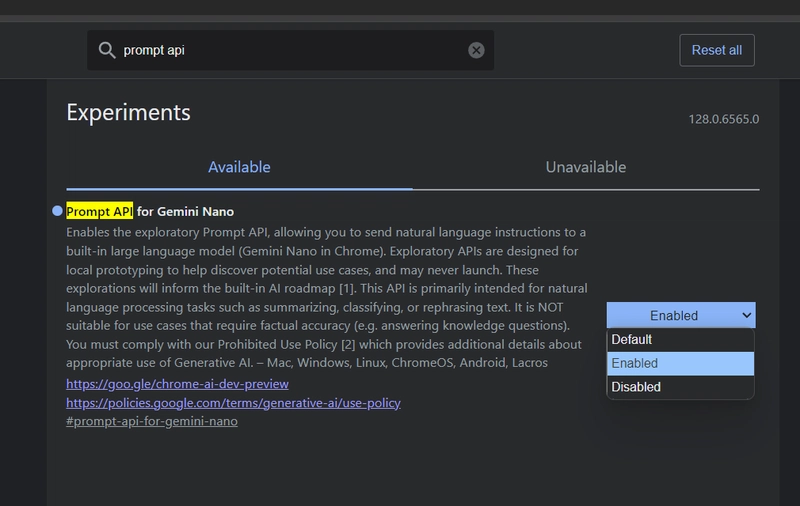

2. 启用“Gemini Nano 的提示 API”。

打开 Chrome Canary 并在 URL 栏中输入“chrome://flags/”并按enter。

然后在顶部的搜索框中输入“prompt API”

您应该看到“Gemini Nano 的 Prompt API”是唯一的选项

将其切换为“已启用”。

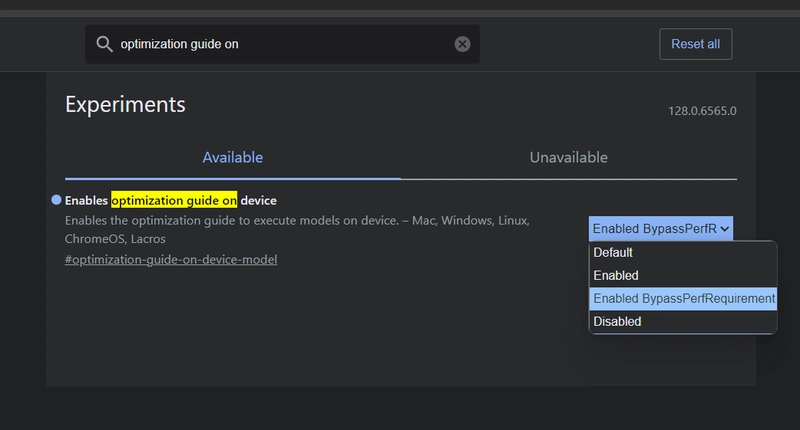

3. 启用“在设备上启用优化指南”

当您在“chrome://flags”页面上时,您需要启用第二项。

删除之前的搜索并搜索“优化指南”。

您应该看到“在设备上启用优化指南”是您唯一的选择。

这次您想启用它,但使用“Enabled ByPassPerfRequirement”选项。

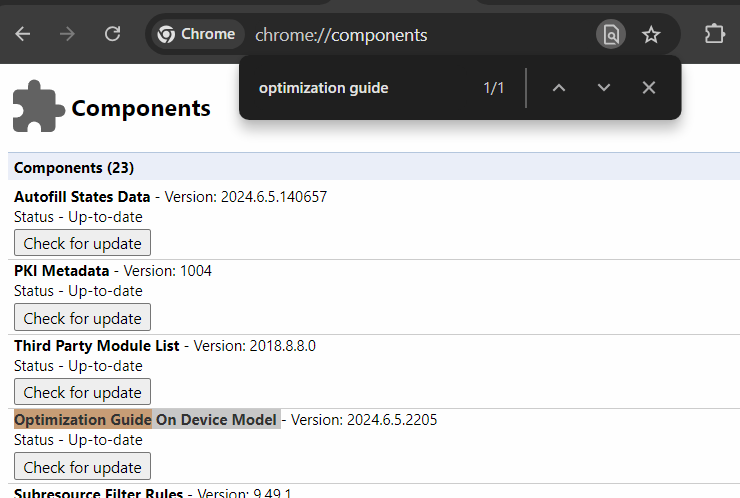

4. 安装 Gemini Nano

最后一步,我们需要在我们的设备上安装 Gemini Nano。

这实际上是一个更大工具的一部分,但我们不需要担心这一点,除了它可以帮助我们知道要下载什么。

警告:此文件大小为 1.5GB。它不会在任何地方显示此大小,因此如果您网速较慢/按 GB 计费/存储空间不足,建议您不要使用此文件!

前往:“chrome://components/”。

点击Ctrl+f并搜索“优化指南”。

您将看到一项“设备模型优化指南”。

单击“检查更新”,它将安装该文件。

5.完成!

最后一步:重新启动 Chrome Canary 以使更改生效。

添加完毕,现在我们可以继续在本地使用 AI 了!

使用window.ai

如果一切按预期进行,那么您现在应该能够打开 DevTools(F12),转到“控制台”选项卡并开始播放!

检查的最简单方法是输入window.控制台并查看是否ai出现选项。

如果没有,请返回并检查您是否错过任何步骤!

创建我们的第一个会话。

只需一个命令即可启动与我们的 AI 模型的会话。

const chatSession = await window.ai.createTextSession()

提示:别忘了await。我最初就是这么做的🤦🏼♂️!

还有一个选项,createGenericSession()但我还没弄清楚有什么区别!

现在我们可以利用该会议来提问。

发送提示

为此,我们只需.prompt在chatSession对象上使用该函数!

const result = await chatSession.prompt("hi, what is your name?")

再一次,全部都是异步的,不要忘记await(我没有犯同样的错误两次......真的!)。

根据提示和硬件的复杂程度,这可能需要几毫秒到几秒钟的时间,但undefined完成后您最终应该在控制台中看到。

得到回应。

现在我们只console.log需要result!

console.log(result)

我们得到:

As a large language model, I do not have a name.

相当令人失望,但至少它有效!

快速且简单的可重复使用示例

显然,您不想一直发送多个命令,因此您可以将此功能复制并粘贴到控制台中以使事情变得更容易:

async function askLocalGPT(promptText){

if(!window.chatSession){

console.log("starting chat session")

window.chatSession = await window.ai.createTextSession()

console.log("chat session created")

}

return console.log(await window.chatSession.prompt(promptText))

}

现在您只需askLocalGPT("prompt text")在控制台中输入即可。

我个人已将其保存为片段,Sources > snippets以便在想要玩的时候可以快速访问。

玩得开心!

它好吗?

不

真的吗?一点也不好?

我的意思是,这取决于您使用的测量标准。

如果你想将它与 Claude 或 ChatGPT 进行比较,那它就很糟糕了。

然而对于本地游戏和实验来说,它非常棒!

还要记住,每次你问一个问题时,它不会自动记住你之前问过的问题。

因此,如果您希望进行对话,让模型“记住”之前所说的内容,那么您需要将之前的问题和答案与新问题结合起来。

玩起来好玩吗?

是的。

我可以在本地浏览器中运行它,这真是太棒了。此外,它还可以解答一些简单的编程问题等等。

最棒的是,无需支付巨额账单!您可以随时使用完整的 32k 上下文窗口,无需担心误操作导致巨额账单。

哦,虽然我说它不是很好,但它可以很好地进行总结:

askLocalGPT("can you summarise this HTML

for me please and explain what the page is

about etc, please return a plain text response

with the summary and nothing else:" + document.querySelector('article').textContent.toString())

稍微播放一下就会输出:

本文介绍如何使用 Google 的大型语言模型 (LGBL) 在浏览器中本地运行 window.ai。

它描述了必要的步骤,包括在 Google Chrome Canary 中启用“Gemini Nano 的提示 API”和“设备型号优化指南”标志、安装 Gemini Nano 以及重新启动 Chrome Canary。

然后,本文演示了如何使用 window.ai,包括创建文本会话、触发 AI 模型以及接收响应。最后,本文讨论了 window.ai 的可能性和未来的增强功能。

你会建造什么?

我只是触及了新 API 的表面,但我发现它对于创建供您自己使用的“自定义 GPT”非常方便。

将来,一旦人工智能可以在浏览器中供每个人使用,谁知道会创造出什么令人惊奇的东西。

最后的想法

虽然作为一名开发人员,我发现这令人兴奋,并且它带来了各种可能性,但我内心很大一部分不喜欢/对此持谨慎态度。

人们已经毫无理由地把“人工智能”投入到一切事物中了。让它在人们的机器上本地运行只会鼓励他们用它来做更愚蠢的事情!

此外,还有大约 50 件与安全、远程人工智能农场等有关的事情,我越想越觉得以后可能会哭。

文章来源:https://dev.to/grahamthedev/windowai-running-ai-locally-from-devtools-202j 后端开发教程 - Java、Spring Boot 实战 - msg200.com

后端开发教程 - Java、Spring Boot 实战 - msg200.com